Proyecto ALEX ¿Pueden los algoritmos influir en nuestras decisiones políticas?

Mark Zuckerberg compareció ante el Senado de EEUU por el acceso de Cambridge Analytica a 87 millones de usaurios en Facebook.

Proyecto ALEX es una propuesta que busca que los usuarios e investigadores monitoreen su propio consumo en redes sociales desvelando cómo trabajan los algoritmos de personalización. Con la ayuda de la herramienta fbTrex nos adentramos en el mundo virtual de los algoritmos como un usuario más tratando de entender el funcionamiento de los mismos. Pues, al parecer, los algoritmos de personalización determinan nuestras dietas informativas en redes sociales.

In 2014 and 2015 Cambridge Analytica subcontracted some digital marketing and software development to AggregateIQ. The suggestion that Cambridge Analytica was somehow involved in any work done by Aggregate IQ in the 2016 EU referendum is entirely false.

— Cambridge Analytica (@CamAnalytica) April 17, 2018

Elecciones estadounidenses, Brexit, redes sociales, noticias falsas, diseño de algoritmos, macrodatos, activismo de datos y privacidad parecen el argumento perfecto para un thriller policíaco de ciencia ficción. Sin embargo, el acceso a millones de datos públicos y privados + la configuración de algoritmos + el uso de inteligencia artificial conducen a plantearnos cuestiones cruciales en este mundo digitalizado, globalizado y dispar: ¿todo lo que vemos en las redes sociales es todo lo que sucede?, ¿pueden los gigantes tecnológicos compartir nuestros datos?, ¿hemos cedido el control de nuestros datos?, ¿pueden los algoritmos influir en nuestras decisiones políticas como influyen en nuestra decisión de compra?

Algoritmos, noticias falsas y elecciones

Como si de una película de espionaje se tratara, la Comunidad de Inteligencia de los Estados Unidos llegó a la conclusión en 2018 de que Rusia interfirió en las elecciones presidenciales de ese país en 2016. La intromisión consistió en el hackeo del Comité Nacional Demócrata y de la cuenta de correo de John Podesta –jefe de campaña de Hillary Clinton– para filtrar información a WikiLeaks. Además de una campaña de desinformación y difusión de noticias falsas a través de las redes sociales. En el Kremlin lo niegan.

Por otra parte, Cambridge Analytica (CA) –consultora privada que combinaba minería de datos, análisis de datos y comunicación estratégica– tuvo acceso a 87 millones de usuarios de Facebook sin que estos lo supieran. Afirma Christopher Wylie –consultor de datos que trabajó para CA– a El País que el Brexit no habría sucedido sin CA. El suceso le costó a Facebook una multa de 5.000 millones de dólares, la comparecencia pública de Mark Zuckerberg ante el Senado de EEUU y la negativa de comparecer ante el Parlamento británico.

Por supuesto, estos acontecimientos no son aislados. Suceden en un contexto donde los algoritmos juegan un papel crucial en la ingeniería de datos al servicio del marketing digital. Lo que plantea una disyuntiva ética en el manejo de la data de millones de personas. Los algoritmos de personalización evalúan nuestro comportamiento en línea y a partir de allí filtran información de interés. Es decir, eligen por nosotros lo que vamos a ver de acuerdo al tipo de páginas que visitamos, los contactos que tenemos, los grupos a los que pertenecemos, nuestros datos públicos y privados.

Por su parte, las empresas encargadas de diseñar dichos algoritmos de personalización los mantienen como un secreto sumarial. Mientras que las investigaciones que se han realizado al respecto se basan en información proporcionada por esas mismas empresas. De hecho, muchas veces los investigadores enfrentan desafíos legales para acceder a dicha data.

En ese sentido, el Proyecto ALEX (Algorithms Exposed) se abre como una vía que permite a los usuarios monitorear su propio consumo en redes sociales. De ahí que nos hemos adentrado en este mundo abstracto, desconocido y virtual con la ayuda de la herramienta fbTrex. Esta se instala como una extensión para Chrome o Mozilla de manera que –en teoría– podríamos entender nuestras dietas informativas en redes sociales.

Abriendo la caja negra de Facebook

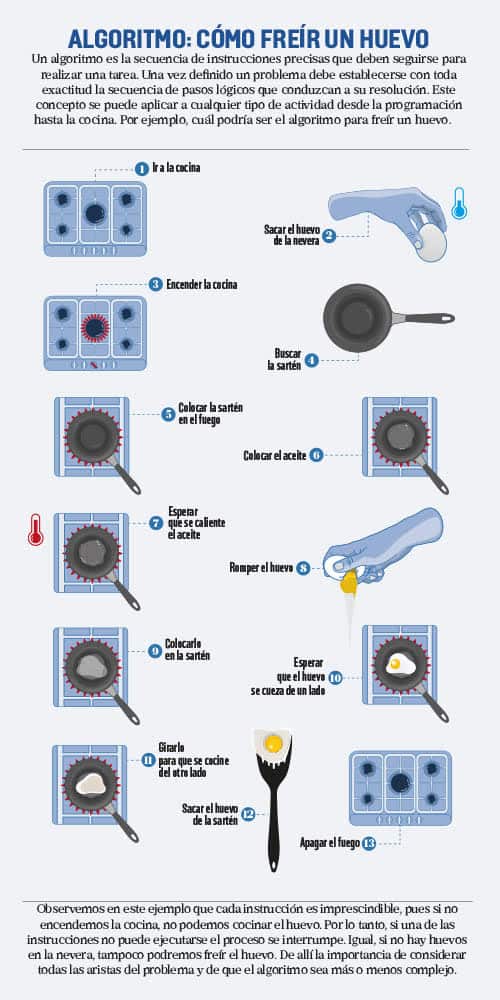

De acuerdo a la guía de instalación, fbTrex es un programa colaborativo que apoya la investigación sobre los algoritmos de personalización. Por algoritmo se entiende una serie de pasos o instrucciones, organizadas, precisas y finitas que permiten la ejecución de una actividad sin lugar a dudas. En el campo de la programación, se trata de una serie de pasos que permiten solucionar un problema.

Ahora, los ingenieros y científicos digitales han creado algoritmos cuyo objetivo principal es conseguir más clics, más usuarios y más tiempo en las plataformas. Esos son los algoritmos de personalización, aquellos que “estudian” nuestro comportamiento en Internet y nos muestran solo información relacionada con nuestros intereses. Por ejemplo, el feed de noticias del perfil en Facebook (primera página que aparece al acceder a esta red social) se alimenta de acuerdo a los likes que hemos dado, las entradas, fotos y vídeos que hemos publicado, las páginas o grupos que seguimos, los contactos con los que establecemos mayores intercambios.

Pablo Castells, ingeniero informático de la Universidad Autónoma de Madrid, señala a BBVA que no hay ningún tipo de perversión en el funcionamiento del algoritmo de personalización –¿no eran algoritmos?–, al contrario su funcionamiento es “muy inocente”, ya que encuentra algo que nos gusta y nos muestra más de lo mismo directamente. Es una especie de filtro que solo nos muestra lo que nos gusta o interesa. En ese contexto los especialistas tienen el papel crucial de establecer los parámetros relacionados con la forma como se procesa esa data.

Los parámetros o matices se dan a través de métricas que pueden eliminar sesgos raciales, radicales o sexistas en las recomendaciones que ofrezca dicho algoritmo. ¿Y es eso posible? Sí, a través de inteligencia artificial, rama de las ciencias computacionales que basada en la combinación de algoritmos crea máquinas capaces de aprender y resolver problemas. En este caso, permite llegar más rápido a lo que nos gusta o interesa.

Jugando a los monos con los algoritmos

Cuando instalas fbTrex, la barra de herramientas de Facebook cambia. El azul característico de la franja superior se difumina hacia los bordes a un verde pálido amarillento. Como toda aplicación presenta un aviso legal importante que debe considerarse para su instalación. Suponemos que los datos en el feed de carácter público son utilizados para medir el comportamiento del algoritmo de personalización.

De acuerdo con Claudio Agosti –desarrollador de la herramienta y autor de la idea original de Proyecto ALEX– en una entrevista realizada por Stefania Milan, el objetivo con fbTrex es proporcionar herramientas que ayuden a los usuarios a administrar sus propias dietas de información. Y por otra parte, proporcionar información a investigadores o grupos seleccionados. De manera que contextualicen hallazgos, combinen la data suministrada con otros datos y complementen estos últimos con otros métodos de investigación en ciencias sociales.

Señala Agosti que el objetivo fundamental del proyecto es recopilar datos reales que permitan reflexionar dónde están las responsabilidades a la hora de difundir una noticia falsa. En la producción y difusión de noticias falsas están en juego tres actores: el usuario/lector, el editor de contenido y la plataforma.

¿Dónde está la responsabilidad a la hora de difundir una noticia falsa?

Si decidiéramos que la propagación de noticias falsas es consecuencia de la falta de juicio de los usuarios/lectores, la responsabilidad estaría allí. Mientras que algunos observadores apuntan que la responsabilidad recae en plataformas como Facebook que permiten la publicación de contenido erróneo. Sin embargo, en ese caso la responsabilidad es de los editores de contenido.

Sigue explicando Agosti que de acuerdo a los análisis de las elecciones en Italia y Argentina hallaron dos actores responsables: la plataforma y el editor de contenido. El hallazgo más interesante resultó ser que algunos editores de contenido son de hecho “líneas de tiempo spam de los usuarios”, las cuales producen mucha información con el objetivo de atrapar la atención de usuarios ocupados. Agosti encuentra difícil creer que al ritmo que producen contenido puedan generar información de calidad.

También hallaron que el algoritmo de Facebook es completamente arbitrario a la hora de decidir qué usuario verá el contenido generado. Apunta que de las investigaciones durante las dos campañas electorales se registró evidencia de que si una persona expresa un comportamiento fascista o populista las plataformas están diseñadas para mostrarle contenido menos diverso comparado con otros usuarios, lo que reforzaría su posición radical.

Ahora, volviendo con la instalación y uso de fbTrex, como usuarios podemos decidir que ya no queremos que la herramienta analice nuestra data, por lo tanto, nuestra información será eliminada de sus registros y podremos desinstalarla. Sin embargo, –¿los creadores de la herramienta?– no se hacen responsables por el uso de los datos que hagan terceros, aquellos que hayan tenido acceso a nuestra data mientras formamos parte del experimento.

Proyecto ALEX: La guerra fría digital

Ya en las entrañas de este mundo virtual, discerniendo entre los intríngulis de datos que conducen a intríngulis políticos, resulta que la presunta intromisión rusa en los docs del partido demócrata estadounidense tuvo consecuencias políticas, diplomáticas y legislativas. En primer lugar, según las agencias de inteligencia de EEUU, llevó a Donald Trump a la Casa Blanca, mientras Hillary Clinton perdía las elecciones.

Luego, eso derivó en la expulsión de 35 diplomáticos rusos –entre otros actores– de territorio estadounidense. En cuanto al Brexit, aún las consecuencias sacuden a Reino Unido que deambula en un limbo jurídico donde es y no es parte de la Unión Europea, mientras Theresa May quedó fuera de juego dejando como primer ministro a un conservador aún más radical, Boris Johnson.

[ITA] Claudio Agosti @_vecna ci parla ad #epricacy di “Facebook: aprire l’algoritmo e liberare i dati” a riguardo del progetto FB Tracking Exposed italynX#eprivacy XXIV 2018 Winter Edition

– GDPR vs Tecnologie Emergenti –A Roma in Campidoglio https://t.co/C3u6LxZucU pic.twitter.com/Ufo3lfDAph

— Hermes Center (@HermesCenter) November 30, 2018

La reacción en cadena no se hizo esperar. La Unión Europea enfiló su artillería hacia los terrenos de Internet de manera que se puedan legislar los datos para proteger a los ciudadanos, no sin antes descubrir cómo es que el algoritmo de personalización puede incidir en el imaginario político europeo y quizás influir en las pasadas elecciones europarlamentarias nada más y nada menos.

Tomando como base las europarlamentarias, Proyecto ALEX sigue buscando datos, respuestas y responsabilidades. ALEX está organizado por el Departamento de Estudios de Medios de la Universidad de Ámsterdam y financiado por una subvención de Prueba de Concepto del Consejo Europeo de Investigación dentro de la Comisión Europea. Su investigadora líder es Stefania Milan, mientras que Claudio Agosti se encarga del desarrollo técnico de fbTrex.

Facebook es solo un caso de prueba, pero el proyecto incluye testear el enfoque en Twitter y Google. La financiación de ALEX ha sido de 149.922 euros y se enmarca en un proyecto más amplio, DATACTIVE un colectivo de investigación que explora las políticas de big data con una postura crítica hacia la recopilación masiva de datos. Sí, abrumadora y exhaustiva parece esta cadena de eventos desatada por el auge de noticias falsas.

Entonces, ¿influyen o no los algoritmos de personalización en nuestras decisiones políticas? Nuestro viaje con fbTrex no nos deja ni pruebas ni una experiencia concluyente que permita afirmar que los algoritmos de personalización son capaces de influenciar decisiones políticas ni mucho menos dar respuestas a las cuestiones inicialmente planteadas. Tampoco sabemos cómo es que funciona el algoritmo de personalización a pesar de que descargamos la herramienta y ofreció ciertos resultados. Lo que nos lleva solo a suponer que Proyecto ALEX es un mundo en construcción.

Sin embargo, de acuerdo a la experiencia algorítmica vivida, sí queda la certeza de que no podemos seguir dando a “Aceptar” sin siquiera mirar las más mínimas condiciones de privacidad, porque a pesar de que la privacidad forma parte de nuestros derechos más fundamentales ¿estamos protegidos contra los ataques a nuestra intimidad en Internet? Al parecer, no.

Para más información visite Cambio16.com

Puede adquirirla impresa, en digital, suscripción digital y suscripción total.

-

Revista 2260 (Digital)

2,30€ Añadir al carrito -

Revista 2260

4,00€ Añadir al carrito -

¡Oferta!

Revista 2260 Suscripción Digital

El precio original era: 23,00€.19,90€El precio actual es: 19,90€. Añadir al carrito -

¡Oferta!

Revista 2260 Suscripción Total

El precio original era: 40,00€.36,00€El precio actual es: 36,00€. Añadir al carrito

Suscríbete y apóyanos «Por un mundo más humano, justo y regenerativo»

Gracias por leer Cambio16. Vuestra suscripción no solo proporcionará noticias precisas y veraces, sino que también contribuirá al resurgimiento del periodismo en España para la transformación de la conciencia y de la sociedad mediante el crecimiento personal, la defensa de las libertades, las democracias, la justicia social, la conservación del medio ambiente y la biodiversidad.

Dado que nuestros ingresos operativos se ven sometidos a una gran presión, su apoyo puede ayudarnos a llevar a cabo el importante trabajo que hacemos. Si puedes, apoya a Cambio16 ¡Gracias por tu aportación!

-

Revista 2309 (Digital)

2,30€ Añadir al carrito -

Revista 2309

4,00€ Añadir al carrito -

¡Oferta!

Revista 2309 Suscripción Digital

El precio original era: 23,00€.19,90€El precio actual es: 19,90€. Añadir al carrito -

¡Oferta!

Revista 2309 Suscripción Total

El precio original era: 40,00€.36,00€El precio actual es: 36,00€. Añadir al carrito